摘要

這 48 小時的 AI 產業,不是「又一個模型發布日」,而是「治理框架與工程基礎設施同步升級」的轉折點。平台端(OpenAI、GitHub、Anthropic)分別在行為規範、資料政策與法律攻防上釋出明確訊號;開源端(SGLang、Repomix、Cherry Studio、OpenClaw)則持續把部署效率與代理工作流產品化。對團隊而言,競爭力正從單點模型效果,轉向「合規可控 + 交付效率 + 系統可替換性」的綜合能力。

1) OpenAI 公開 Model Spec 方法論

背景:

- OpenAI 發布官方文章,解釋其 Model Spec 的設計思路與取捨,目標是讓模型行為更一致、可預期。

- 這代表「模型行為」正被產品化成可治理的規範層,而非僅靠 prompt 與後處理補救。

- 來源:https://openai.com/index/our-approach-to-the-model-spec

影響:

- 對企業客戶而言,這提升了導入時的可審計性與風險可解釋性。

- 對開發團隊而言,提示工程與安全策略需與平台規範對齊,避免依賴不穩定行為。

接下來觀察:

- 是否會進一步提供更細粒度的政策控制介面與版本差異說明。

- 生態系是否出現針對 Model Spec 的第三方測試/稽核工具。

2) OpenAI 暫緩成人向聊天功能,顯示高風險能力上線趨保守

背景:

- 媒體報導 OpenAI 已暫緩成人向聊天機器人計畫。

- 該議題涉及內容安全、品牌風險、監管壓力與平台責任。

- 來源:https://www.engadget.com/ai/openai-drops-plans-to-release-an-adult-chatbot-113121190.html

影響:

- 生成式產品的功能路線圖會更明確分成「可公開規模化」與「高風險灰區」兩層。

- 競品即便短期推出更激進功能,也可能面臨更高的政策與商業反噬風險。

接下來觀察:

- OpenAI 是否公布替代方案(例如更細緻的年齡/情境分級機制)。

- 其他大模型供應商是否跟進保守策略,形成產業共識。

3) Anthropic 供應鏈風險標記被法院初步擋下,AI 進入法律博弈常態

背景:

- 法院文件顯示 Anthropic 取得初步禁制令;主流媒體亦跟進報導。

- 來源:

影響:

- AI 公司與政府機構之間的風險認定,將更依賴法律程序與證據門檻。

- 企業採購端會更重視「政策可逆性」與供應商的法務韌性。

接下來觀察:

- 後續正式審理結果及其對政府採購/關鍵基礎設施名單制度的影響。

- 是否引發同類案件,形成 AI 供應鏈治理的新判例路徑。

4) GitHub 更新 Copilot 資料使用政策,開發者資料治理壓力升高

背景:

- GitHub 公布 Copilot 互動資料政策更新,引發開發者與企業對資料使用邊界的關注。

- 來源:https://github.blog/news-insights/company-news/updates-to-github-copilot-interaction-data-usage-policy/

影響:

- 企業需重新檢視組織層級的 AI 使用政策、repo 分級、機密程式碼隔離策略。

- 工程流程可能轉向「可選退出 + 明確資料分層 + 審計紀錄」的標準化操作。

接下來觀察:

- 主要雲端與 AI IDE 平台是否推出更細緻的企業控制選項。

- 開發者工具市場是否加速往 self-host / private inference 遷移。

5) Gemini 3.1 Flash Live:即時語音代理進入可用性競爭

背景:

- Google DeepMind 發布 Gemini 3.1 Flash Live,主打語音互動的自然度與穩定性。

- 來源:https://deepmind.google/blog/gemini-3-1-flash-live-making-audio-ai-more-natural-and-reliable/

影響:

- 語音客服、語音助理、即時翻譯等場景的產品門檻下降。

- 差異化重點從「能不能做」轉向「延遲、穩定性、成本與聲音體驗」。

接下來觀察:

- 真實商業場景中的延遲/成本曲線是否優於上一代方案。

- 生態是否快速出現針對語音代理的框架與評測基準。

6) 開源生態聚焦部署效率:SGLang、Repomix、Cherry Studio、OpenClaw

背景:

- SGLang、Repomix、Cherry Studio 在 GitHub Trending 維持熱度,OpenClaw 釋出新版本。

- 來源:

影響:

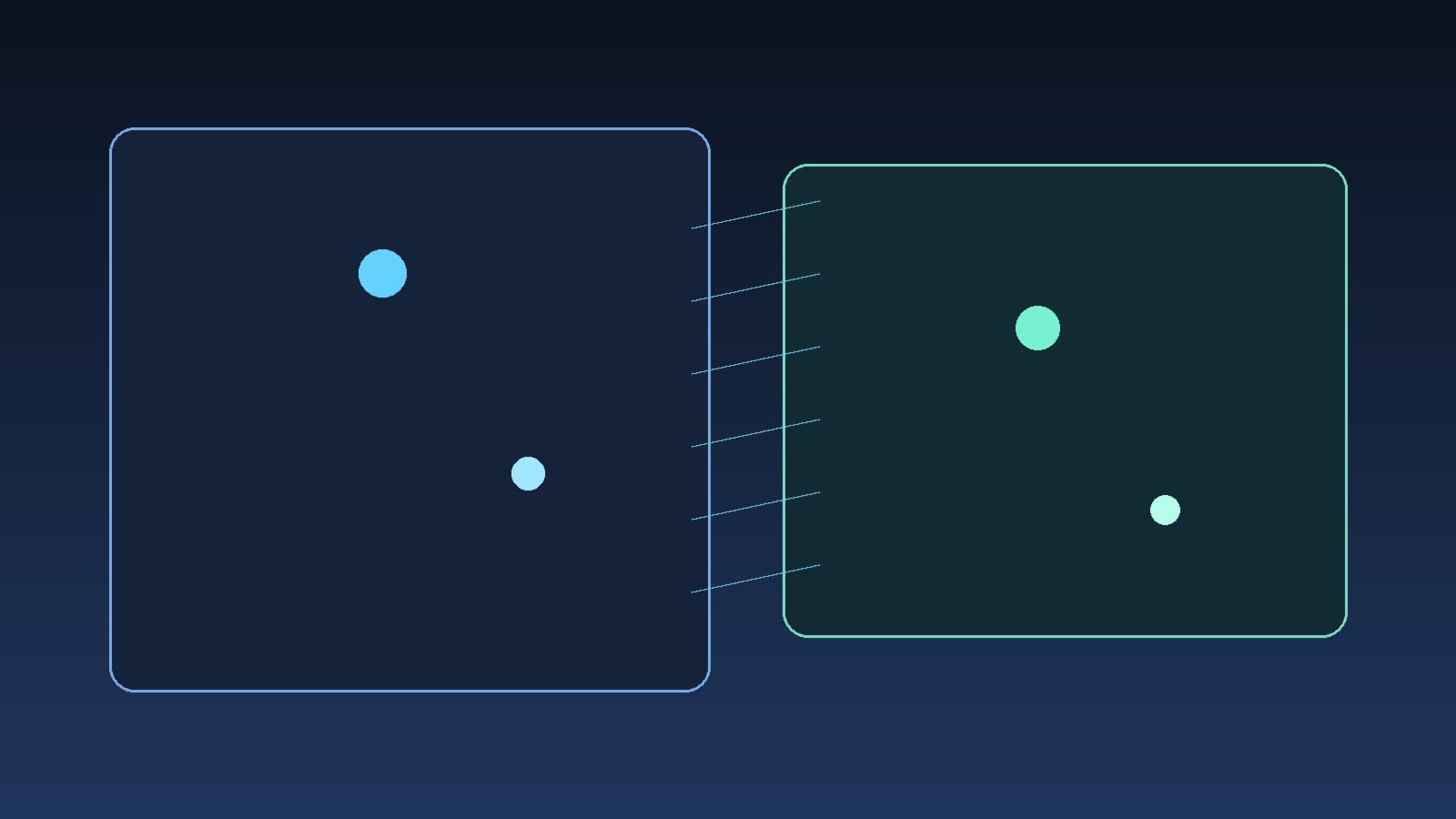

- 企業 AI 技術棧逐步拆成可替換模組:推理層、上下文打包層、代理協作層。

- 團隊競爭力將更多取決於整合速度與維運能力,而非單一供應商綁定。

接下來觀察:

- 這些工具在生產環境的穩定性、授權風險與長期維護社群表現。

- 是否出現標準化的「代理工作流可觀測性」方案,降低多代理系統調試成本。

今日觀點

若把這 48 小時濃縮成一句話:AI 正從能力競賽進入制度化交付競賽。平台公司在政策與法務上收斂,開源社群在工程效率上外擴;兩者共同把市場推向一個新平衡——「既要快,也要可控」。對產品與工程團隊來說,現在最值得投資的不是再追一個新模型,而是建立可替換、可追溯、可審計的 AI 生產系統。

參考資料

- https://openai.com/index/our-approach-to-the-model-spec

- https://www.engadget.com/ai/openai-drops-plans-to-release-an-adult-chatbot-113121190.html

- https://storage.courtlistener.com/recap/gov.uscourts.cand.465515/gov.uscourts.cand.465515.134.0.pdf

- https://www.cnn.com/2026/03/26/business/anthropic-pentagon-injunction-supply-chain-risk

- https://github.blog/news-insights/company-news/updates-to-github-copilot-interaction-data-usage-policy/

- https://deepmind.google/blog/gemini-3-1-flash-live-making-audio-ai-more-natural-and-reliable/

- https://github.com/sgl-project/sglang

- https://github.com/yamadashy/repomix

- https://github.com/CherryHQ/cherry-studio

- https://github.com/openclaw/openclaw/releases/tag/v2026.3.24